更多“如果一个函数在其函数体内直接或间接地调用自己,则该函数称为(…”相关的问题

更多“如果一个函数在其函数体内直接或间接地调用自己,则该函数称为(…”相关的问题

第1题

以下哪一项不属于ReLU系列的激活函数相对于Sigmoid和Tanh激活函数的优点?()

A.ReLU的单侧抑制提供了网络的稀疏表达能力。

B.ReLU在其训练过程中会导致神经元死亡的问题。

C.从计算的角度上,Sigmoid和Tanh激活函数均需要计算指数,复杂度高,而ReLU只需要一个阈值即可得到激活值。

第4题

图像预处理的滤波实验中,以下哪一个函数是调用OpenCV的中值模糊API?()

A.cv2.GaussianBlur(im, (5,5),0)

B.cv2.blur(im, (3,3))

C.cv2.medianBlur(im,5)

D.cv2.filter2D (im,-1,sharpen_1)

第5题

下面对3的叙述中,不正确的说法是()。

A.3模式中不存属性对侯选键的传递依赖

B.3模式不存在非主属性对侯选键的部分依赖

C.如果模式R是3,那么R一定是2

D.任何一个关系模式都可以既保持函数依赖又无损地分解为一系列3集

第6题

假设某商业集团数据库中有一关系模式R如下:R(商店编号,商品编号,数量,部门编号,负责人)如果规定:(1)每个商店的每种商品只在一个部门销售;(2)每个商店的每个部门只有一个负责人;(3)每个商店的每种商品只有一个库存数量。试回答下列问题:(1)根据上述规定,写出关系模式R的基本函数依赖;(2)找出关系模式R的候选码;(3)试问关系模式R最高已经达到第几范式?为什么?(4)如果R不属于3NF,请将R分解成3NF模式集。

第9题

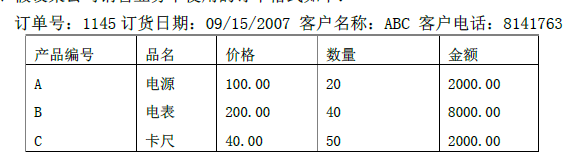

假设某公司销售业务中使用的订单格式如下:公司的业务规定:订单号是唯一的,每张订单对应一个订单号;一张订单可以订购多种产品,每一种产品可以在多个订单中出现;一张订单有一个客户,且一个客户可以有多张订单;每一个产品编号对应一种产品的品名和价格;每一个客户有一个确定的名称和电话号码。试根据上述表格和业务规则设计关系模式:R(订单号,订货日期,客户名称,客户电话,产品编号,品名,价格,数量)试回答下列问题:(1)出R的基本函数依赖集。(2)出R的候选码。(3)判断R最高可达到第几范式?为什么?(4)如果R不属于3NF,请将R分解成3NF模式集

如果结果不匹配,请

如果结果不匹配,请